Ich habe die GitHub-API am 18. März 2026 extrahiert. Ich habe Reddit-Threads mit insgesamt über 1.500 Upvotes gelesen. Ich habe die Preisseiten, Versionshistorien, Commit-Grafiken überprüft.

Keine Wellen. Daten.

Die Zahlen

| LangChain | CrewAI | AutoGen | |

|---|---|---|---|

| GitHub-Sterne | 130.068 | 46.455 | 55.836 |

| Forks | 21.444 | 6.268 | 8.414 |

| Offene Fragen | 505 | 494 | 684 |

| Lizenz | MIT | MIT | CC-BY-4.0 |

| Letzte stabile Version | 17. März 2026 | 18. März 2026 (v1.11.0) | 30. September 2025 (v0.7.5) |

| Commits (letzte 4 Wochen) | 187 insgesamt | 3 RCs in 3 Tagen | Fast null |

| Geboren | Okt 2022 | Okt 2023 | Aug 2023 |

Quelle: GitHub-API, extrahiert am 18. März 2026.

LangChain: 130K Sterne, 47 Commits/Woche, drei Jahre und sechs Monate alt und es beschleunigt weiter. Sagen Sie, was Sie wollen über die DX – das Team liefert.

CrewAI: 46K Sterne in zwei Jahren und sechs Monaten. Drei Versionskandidaten an drei aufeinanderfolgenden Tagen, bevor v1.11.0 stabil wird. Energie eines kleinen Teams. Es geht schnell voran, wahrscheinlich brechen sie Dinge, aber zumindest kommen sie voran.

AutoGen: hier wird es unangenehm. Letzte stabile Version? September 2025. Sechs Monate Stille von einem Projekt, das von Microsoft unterstützt wird. 684 offene Fragen, die sich anhäufen. Die Neuschreibung v0.4 hat die Gemeinschaft gespalten zwischen denen, die die alte API nutzen, und denen, die versuchen, die neue zu verstehen. Keine der beiden Gruppen scheint glücklich zu sein.

Zeig mir den Code

Genug geredet. Hier ist die gleiche Aufgabe – ein Wetterprüfer-Agent – in jedem Framework plus das Standard-SDK. Urteilen Sie selbst.

OpenAI Roh-SDK (ohne Framework)

from openai import OpenAI

import json

client = OpenAI()

def get_weather(city: str) -> str:

return f"72°F und sonnig in {city}" # Ihr tatsächlicher API-Aufruf hier

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Aktuelles Wetter für eine Stadt abrufen",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

}]

messages = [{"role": "user", "content": "Wie ist das Wetter in Tokio?"}]

response = client.chat.completions.create(

model="gpt-4o", messages=messages, tools=tools

)

# Werkzeugaufruf verarbeiten

tool_call = response.choices[0].message.tool_calls[0]

result = get_weather(json.loads(tool_call.function.arguments)["city"])

messages.append(response.choices[0].message)

messages.append({"role": "tool", "content": result, "tool_call_id": tool_call.id})

final = client.chat.completions.create(model="gpt-4o", messages=messages)

print(final.choices[0].message.content)

25 Zeilen. Null Magie. Sie sehen jede eingehende und ausgehende Nachricht. Wenn es bricht – und es wird brechen – wissen Sie genau, wo Sie schauen müssen.

Darum ging es in diesem Reddit-Beitrag mit 685 Upvotes, als er sagte „bauen Sie Ihr erstes in Rohform.“.

LangChain

from langchain.agents import create_agent

def get_weather(city: str) -> str:

"""Aktuelles Wetter für eine Stadt abrufen."""

return f"72°F und sonnig in {city}"

agent = create_agent(

model="gpt-4o",

tools=[get_weather],

system_prompt="Sie sind ein hilfsbereiter Wetterassistent."

)

response = agent.invoke("Wie ist das Wetter in Tokio?")

print(response)

Sauber. Kurz. Und völlig intransparent. Was passiert im Inneren von agent.invoke()? Tool-Loop, Nachrichtenformatierung, Retry-Logik, vielleicht ein wenig Prompt-Modeling. Alles wird für Sie verwaltet. Wundervoll – bis 2 Uhr morgens, wenn Ihr Agent beginnt, Unsinn zurückzugeben und Sie durch fünf Schichten Abstraktion gehen, um zu versuchen, zu verstehen, welche Ihre Antwort vom Werkzeug gegessen hat.

Der wahre Wert von LangChain ist nicht die Abstraktion des Agents. Es sind die über 150 Integrationen (alle Vektor-Datenbanken, alle LLM-Anbieter, alle Document Loader, die Sie sich vorstellen können) und LangSmith, das wirklich das beste Debugging-Tool für Agenten ist, das derzeit verfügbar ist. Dazu später mehr.

CrewAI

from crewai import Agent, Task, Crew

from crewai.tools import tool

@tool

def get_weather(city: str) -> str:

"""Aktuelles Wetter für eine Stadt abrufen."""

return f"72°F und sonnig in {city}"

weather_agent = Agent(

role="Wetterberichtgeber",

goal="Genaues Wetterinformationen bereitstellen",

backstory="Sie sind ein Meteorologe, der prägnante Wetterberichte gibt.",

tools=[get_weather]

)

task = Task(

description="Wie ist das Wetter in Tokio?",

expected_output="Ein kurzer Wetterbericht",

agent=weather_agent

)

crew = Crew(agents=[weather_agent], tasks=[task])

result = crew.kickoff()

print(result)

Mehr Zeilen, eine völlig andere Stimmung. Sie schreiben kein Skript, Sie inszenieren einen Film. role, goal, backstory – der Agent hat einen Charakterbogen, bevor er überhaupt etwas getan hat.

Um das Wetter zu prüfen? Ein lächerlicher Overhead. Für einen Content-Pipeline, in der ein „Forscher“ Quellen ausgrabt, ein „Analyst“ Muster findet und ein „Schreiber“ den Artikel verfasst? Jetzt ist die Metapher justified. CrewAI glänzt, wenn das Problem tatsächlich wie Teamarbeit aussieht.

AutoGen

import os

from autogen import AssistantAgent, UserProxyAgent

llm_config = {

"model": "gpt-4",

"api_key": os.environ["OPENAI_API_KEY"]

}

assistant = AssistantAgent("assistant", llm_config=llm_config)

user_proxy = UserProxyAgent("user_proxy", code_execution_config=False)

user_proxy.initiate_chat(assistant, message="Wie ist das Wetter in Tokio?")

Zwei Agenten. Sprechen miteinander. Das ist das Ganze von AutoGen – das Konversationsschema. UserProxyAgent gibt vor, Sie zu sein, AssistantAgent antwortet. Für Brainstorming oder Codeüberprüfung ist es ein interessantes Paradigma.

Für „gib mir einfach das Wetter in Tokio“? Es ist, als würde man zwei Personen anheuern, um ein Meeting zur Überprüfung der Wetter-App abzuhalten.

Außerdem: das Modell in ihrem offiziellen Beispiel ist immer noch gpt-4, nicht gpt-4o. Die Dokumentation wurde nicht aktualisiert. Das ist ein kleines Detail. Es ist auch kein kleines Detail.

Was Reddit wirklich denkt

Direkte Zitate. Upvote-Konten sind enthalten, damit Sie sie selbst abwägen können.

Die lauteste Stimme im Raum sagt: Vermeiden Sie Frameworks

Von einem Entwickler, der Agenten für mehr als 20 Unternehmen gebaut hat (685 Upvotes) :

„Fangen Sie nicht mit LangChain oder CrewAI oder irgendetwas an, das diese Woche angesagt ist. Sie verstecken zu viele Dinge. Sie müssen verstehen, was unter der Haube vor sich geht. Schreiben Sie ein rohes Python-Skript, das die OpenAI-API oder Anthropic abfragt. Senden Sie eine Nachricht. Erhalten Sie eine Antwort. Das ist alles.“

Von jemandem, der seit zwei Jahren Agenten für Kunden baut (378 Upvotes) :

„Diejenigen, die tatsächlich Geld verdienen und nicht jede Woche abstürzen? Sie sind peinlich einfach. Ein einzelner Agent, der E-Mails liest und CRM-Felder aktualisiert (200 $/Monat, funktioniert 24/7). Ein Lebenslauf-Parser, der die wichtigsten Informationen für Recruiter extrahiert (50 $/Monat). Keiner von ihnen benötigt Agentenorchestrierung. Keiner braucht Gedächtnissysteme. Sie brauchen sicherlich keine Agententeams, die Sitzungen darüber abhalten, was zu tun ist.“

Sein Produktions-Stack: OpenAI API, n8n, ein Webhook, vielleicht Supabase. Das ist alles. Er verdient Geld. Der Typ mit dem CrewAI-System von 47 Agenten macht Posts auf LinkedIn.

Der Gegenpunkt, der es wert ist, gehört zu werden

Ein Kommentator, der tatsächlich einen Agenten in einem Krankenhaus eingesetzt hat (nur 4 Upvotes, aber trotzdem lesen) :

„Ich habe kürzlich einen KI-Sprachagenten in einem Krankenhaus implementiert, der den Zustand der Patienten messbar präziser klassifiziert als das Personal. Es erforderte eine enorme Anpassung und eine hervorragende Systemnachricht, die ihn trainierte, um die Patienten triagieren zu können, aber es funktioniert sehr gut.“

Keine Erwähnung des Frameworks. Weil es nicht wichtig ist. Er hat seine Zeit mit der Aufforderung und der Anpassung verbracht, nicht mit der Auswahl zwischen LangChain und CrewAI.

Was niemand laut aussprechen will

Der Hauptkommentar (75 Upvotes) zu einem beliebten Beitrag „Ich habe 8 Monate damit verbracht, KI-Agenten zu bauen“?

„Danke. Es war wirklich gut ChatGPT.“

Zweiter Kommentar (49 Upvotes): “Die Beiträge, die von Chat GPT geschrieben wurden, sind überall, aber hier ist, was ich gelernt habe. Nichts, weil ich keine Anstrengung unternommen habe.”

Die Hälfte der “Erfahrungsberichte” über KI-Agenten-Frameworks sind selbst von KI generiert. Wir befinden uns in einem Raum voller Spiegel. Behalten Sie das im Hinterkopf, wenn Sie Vergleichsartikel lesen. Einschließlich, potenziell, diesen hier — auch wenn ich gerne denke, dass die GitHub-API-Timestamps und die Reddit-Links mir ein wenig Glaubwürdigkeit verleihen.

Der Geldteil

| LangSmith | CrewAI-Plattform | AutoGen | |

|---|---|---|---|

| Kostenlos | 5K Spuren/Monat, 1 Platz | 50 Ausführungen/Monat | Keine Plattform existiert |

| Bezahlte Version | 39 $/Platz/Monat | 25 $/Monat (100 Ausführungen) | — |

| Unternehmen | Benutzerdefiniert | Benutzerdefiniert | — |

| Wofür Sie bezahlen | Beobachtbarkeit & Debugging | Hosting & Orchestrierung | Ihre eigene Zeit |

Diese Zahlen sind nahezu irrelevant. Hier ist der Grund.

Ein Multi-Agenten-System, in dem drei Agenten ein Problem diskutieren, verbraucht 30-50K Tokens pro Ausführung. Mit dem Tarif von GPT-4o (2,50 $/1M Eingabe, 10 $/1M Ausgabe) kostet das 0,15-0,75 $ pro Ausführung. Wenn man es 1.000 Mal pro Monat macht: 150-750 $ an API-Gebühren. Die 25 $/Monat Gebühren der CrewAI-Plattform sind im Vergleich dazu trivial.

Unterdessen, der E-Mail-Bot für 200 $/Monat von diesem Reddit-Typ? Wahrscheinlich 5-10 $/Monat an API-Aufrufen. Ein einzelner Agent, ein einzelner Prompt, ein einzelner Tool-Call. Die Mathematik ist brutal für Multi-Agenten-Architekturen.

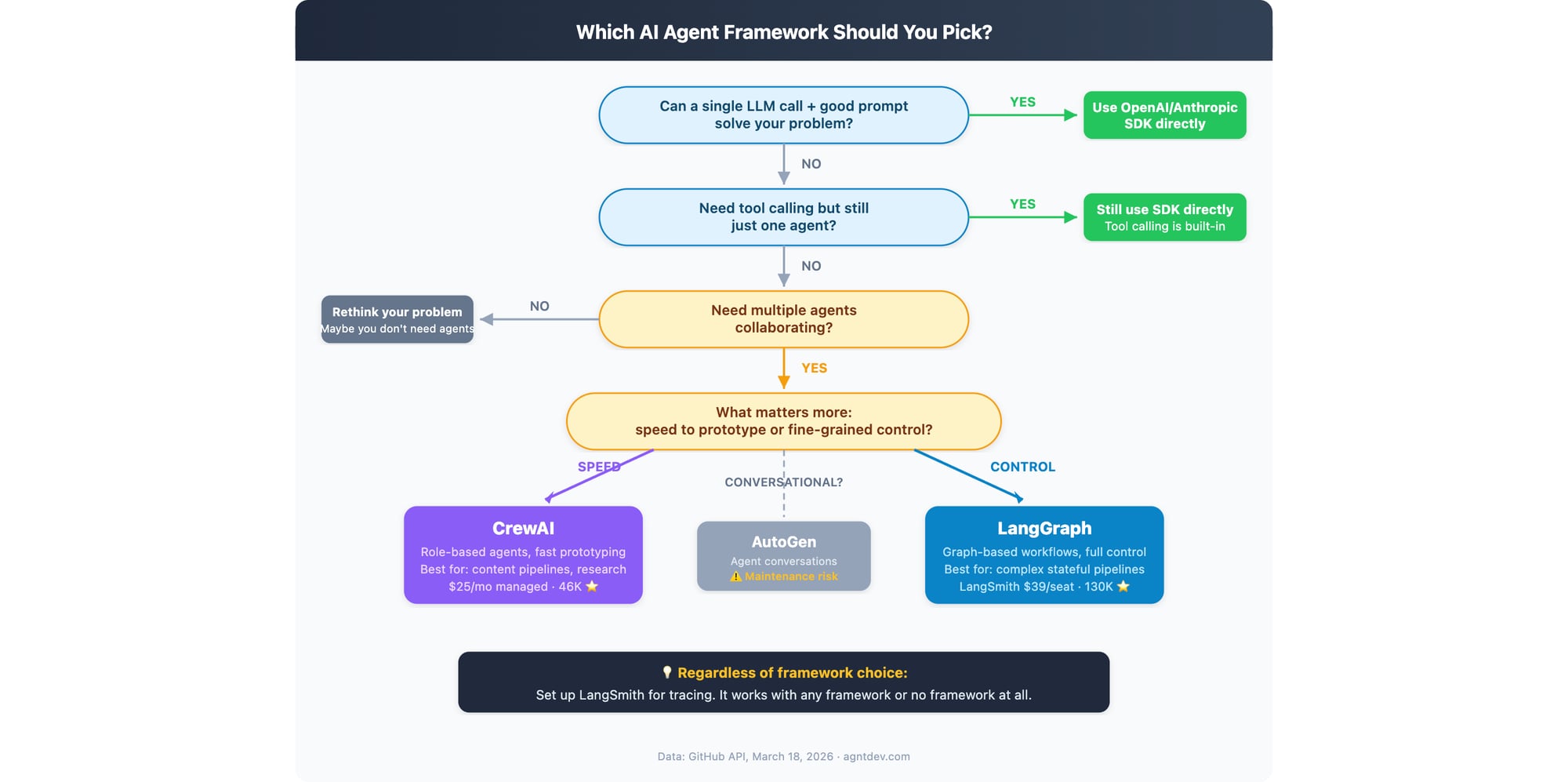

Das Flussdiagramm

In Worten, weil nicht jeder Bilder lädt:

Kann ein LLM-Aufruf mit einem guten Prompt das Problem lösen? → Verwenden Sie das SDK. Hier aufhören. Die meisten Probleme liegen hier und die Leute möchten das nicht zugeben.

Benötigen Sie Tool-Calls, aber immer noch einen Agenten? → Immer noch das SDK. Tool-Calls sind jetzt in jeder großen LLM-API nativ. Sie brauchen kein Framework, um eine Funktion aufzurufen.

Brauchen Sie wirklich mehrere Agenten? (Seien Sie ehrlich zu sich selbst.)

→ Sie wollen Schnelligkeit für das Prototyping: CrewAI

→ Sie wollen vollständige Kontrolle über die Ausführung: LangGraph

→ Sie wollen Agenten, die diskutieren: AutoGen (aber lesen Sie zuerst den Abschnitt über die Wartungsrisiken)

Brauchen Sie Beobachtbarkeit in der Produktion? → LangSmith. Funktioniert mit allem, auch ohne Framework.

Was ich wirklich tun würde

Nicht das, was ich auf einer Konferenz empfehlen würde. Was ich wirklich tun würde, wenn ich nächste Woche etwas liefern müsste:

- V1 mit rohen SDK-Calls bauen. Hässlich, manuell, ohne Abstraktionen. Das zum Laufen bringen. Zuschauen, wie es scheitert. Verstehen, warum es scheitert.

- Wenn ein Agent es wirklich nicht schaffen kann, die Multi-Agenten-Version in CrewAI prototypisieren. Das wird einen Nachmittag dauern.

- Wenn der CrewAI-Prototyp funktioniert, aber ich für die Produktion eine strengere Kontrolle benötige, die kritischen Pfade in LangGraph neu schreiben. CrewAI für die Teile behalten, wo „gut genug“ ausreicht.

- LangSmith von Anfang an. Unverhandelbar. In der Ungewissheit mit Agenten in der Produktion zu sein, ist, wie man um 3 Uhr morgens Benachrichtigungen erhält.

Der fünfte Punkt ist der, dem niemand folgt: keine Komplexität hinzufügen, solange die einfache Version nicht in der Produktion bricht. Weder während der Tests. Noch in Ihrem Kopf. In der Produktion, mit echten Benutzern, die echte Dinge tun. Die meisten Leute gehen nie über die erste Phase hinaus, weil die erste Phase tatsächlich funktioniert.

Das Framework ist 10 % des Ergebnisses. Der Prompt, die Tool-Definitionen, das Fehlerhandling, die Evaluierung — das sind die restlichen 90 %. Dort hat der Typ im Krankenhaus seine Zeit verbracht. Dort hat der Typ mit dem E-Mail-Bot für 200 $/Monat seine Zeit verbracht.

Dort sollten auch Sie Ihre Zeit verbringen.

Daten: GitHub API (18. März 2026), LangSmith Preise, CrewAI Preise. Reddit-Diskussionen über r/AI_Agents und r/LangChain. Aktualisiert am 19. März 2026.

Verwandte Artikel

- Agententests meistern: Ein praktisches Tutorial mit Beispielen

- Beste AI-Code-Completion-Tools 2025: Produktivität von Entwicklern steigern

- Make vs Activepieces: Welches für kleine Teams

🕒 Published: