Ho estratto l’API di GitHub il 18 marzo 2026. Ho letto attraverso i thread di Reddit con un totale di 1.500+ voti positivi. Ho controllato le pagine di prezzo, le storie di rilascio, i grafici dei commit.

Non sono vibrazioni. Sono dati.

I Numeri

| LangChain | CrewAI | AutoGen | |

|---|---|---|---|

| GitHub Stars | 130.068 | 46.455 | 55.836 |

| Forks | 21.444 | 6.268 | 8.414 |

| Open Issues | 505 | 494 | 684 |

| License | MIT | MIT | CC-BY-4.0 |

| Latest Stable | 17 mar 2026 | 18 mar 2026 (v1.11.0) | 30 set 2025 (v0.7.5) |

| Commits (ultime 4 settimane) | 187 in totale | 3 RC in 3 giorni | Quasi zero |

| Nato | Ott 2022 | Ott 2023 | Ago 2023 |

Fonte: API di GitHub, estratto il 18 marzo 2026.

LangChain: 130K stelle, 47 commit/settimana, tre anni e mezzo di età e ancora in accelerazione. Dite quello che volete sul DX — il team produce.

CrewAI: 46K stelle in due anni e mezzo. Tre release candidate in tre giorni consecutivi prima che v1.11.0 diventasse stabile. Energia di un piccolo team. Si muovono velocemente, probabilmente rompendo delle cose, ma almeno si stanno muovendo.

AutoGen: qui le cose diventano scomode. Ultima versione stabile? Settembre 2025. Sei mesi di silenzio da un progetto sostenuto da Microsoft. 684 problemi aperti che si accumulano. La riscrittura di v0.4 ha diviso la comunità tra chi usa la vecchia API e chi cerca di capire la nuova. Nessun gruppo sembra essere felice.

Mostrami il Codice

Basta chiacchiere. Ecco lo stesso compito — un agente di controllo meteo — in ciascun framework più l’SDK vanilla. Giudica tu stesso.

Raw OpenAI SDK (nessun framework)

from openai import OpenAI

import json

client = OpenAI()

def get_weather(city: str) -> str:

return f"72°F e soleggiato a {city}" # tua vera chiamata API qui

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Ottieni il meteo attuale per una città",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

}]

messages = [{"role": "user", "content": "Che tempo fa a Tokyo?"}]

response = client.chat.completions.create(

model="gpt-4o", messages=messages, tools=tools

)

# Gestisci la chiamata dello strumento

tool_call = response.choices[0].message.tool_calls[0]

result = get_weather(json.loads(tool_call.function.arguments)["city"])

messages.append(response.choices[0].message)

messages.append({"role": "tool", "content": result, "tool_call_id": tool_call.id})

final = client.chat.completions.create(model="gpt-4o", messages=messages)

print(final.choices[0].message.content)

25 righe. Zero magia. Vedi ogni messaggio che entra e esce. Quando si rompe — e lo farà — saprai esattamente dove guardare.

Questo è ciò di cui parlava quel post di Reddit con 685 voti positivi quando diceva “costruisci il tuo primo in modo grezzo.”

LangChain

from langchain.agents import create_agent

def get_weather(city: str) -> str:

"""Ottieni il meteo attuale per una città."""

return f"72°F e soleggiato a {city}"

agent = create_agent(

model="gpt-4o",

tools=[get_weather],

system_prompt="Sei un utile assistente meteo."

)

response = agent.invoke("Che tempo fa a Tokyo?")

print(response)

Pulito. Breve. E completamente opaco. Cosa succede dentro agent.invoke()? Ciclo di chiamate agli strumenti, formattazione dei messaggi, logica di ripetizione, magari qualche template per il prompt. Tutto gestito per te. Meraviglioso — fino alle 2 del mattino quando il tuo agente inizia a restituire nonsenso e tu sei nel bel mezzo di cinque strati di astrazione cercando di capire quale ha mangiato la tua risposta dello strumento.

Il vero valore di LangChain non è l’astrazione dell’agente. Sono le oltre 150 integrazioni (ogni store di vettori, ogni fornitore di LLM, ogni caricatore di documenti che ti venga in mente) e LangSmith, che è davvero il miglior strumento di debugging per agenti disponibile al momento. Di più su questo più avanti.

CrewAI

from crewai import Agent, Task, Crew

from crewai.tools import tool

@tool

def get_weather(city: str) -> str:

"""Ottieni il meteo attuale per una città."""

return f"72°F e soleggiato a {city}"

weather_agent = Agent(

role="Reporter Meteo",

goal="Fornire informazioni meteorologiche accurate",

backstory="Sei un meteorologo che fornisce report meteorologici concisi.",

tools=[get_weather]

)

task = Task(

description="Che tempo fa a Tokyo?",

expected_output="Un breve report meteo",

agent=weather_agent

)

crew = Crew(agents=[weather_agent], tasks=[task])

result = crew.kickoff()

print(result)

Più righe, atmosfera completamente diversa. Non stai scrivendo uno script, stai girando un film. role, goal, backstory — l’agente ha una trama del personaggio prima ancora di aver fatto qualcosa.

Per controllare il meteo? Ridicolo sovraccarico. Per un pipeline di contenuti dove un “Ricercatore” scava fonti, un “Analista” trova schemi e un “Scrittore” scrive il pezzo? Ora la metafora ha senso. CrewAI brilla quando il problema assomiglia realmente al lavoro di squadra.

AutoGen

import os

from autogen import AssistantAgent, UserProxyAgent

llm_config = {

"model": "gpt-4",

"api_key": os.environ["OPENAI_API_KEY"]

}

assistant = AssistantAgent("assistant", llm_config=llm_config)

user_proxy = UserProxyAgent("user_proxy", code_execution_config=False)

user_proxy.initiate_chat(assistant, message="Che tempo fa a Tokyo?")

Due agenti. Che parlano tra di loro. Questo è tutto il concetto di AutoGen — il modello conversazionale. UserProxyAgent finge di essere te, AssistantAgent risponde. Per il brainstorming o la revisione del codice, è un paradigma interessante.

Per “fammi sapere solo il meteo a Tokyo”? È come assumere due persone per avere una riunione su come controllare l’app meteo.

Inoltre: il modello nel loro esempio ufficiale è ancora gpt-4, non gpt-4o. La documentazione non è stata aggiornata. È una piccola cosa. Ma non è anche una piccola cosa.

Cosa pensa realmente Reddit

Citazioni dirette. I conteggi dei voti positivi inclusi così puoi valutare tu stesso.

La voce più forte nella stanza dice: salta i framework

Da uno sviluppatore che ha creato agenti per oltre 20 aziende (685 voti positivi):

“Non iniziare con LangChain o CrewAI o qualsiasi cosa sia di tendenza questa settimana. Nascondono troppo. Devi capire cosa succede sotto il cofano. Scrivi uno script Python grezzo che colpisca l’API di OpenAI o Anthropic. Invia un messaggio. Ottieni una risposta. Questo è tutto.”

Da qualcuno che costruisce agenti per clienti da due anni (378 voti positivi):

“Quelli che realmente fanno soldi e non si rompono ogni settimana? Sono imbarazzantemente semplici. Un singolo agente che legge le email e aggiorna i campi CRM ($200/mese, funziona 24/7). Un parser di curriculum che estrae informazioni chiave per i reclutatori ($50/mese). Nessuno di questi ha richiesto un’orchestrazione degli agenti. Nessuno ha richiesto sistemi di memoria. Non hanno assolutamente bisogno di gruppi di agenti che si riuniscano per decidere cosa fare.”

Il suo stack di produzione: API di OpenAI, n8n, un webhook, forse Supabase. Questo è tutto. Sta guadagnando. Il tipo con il sistema CrewAI da 47 agenti sta facendo post su LinkedIn.

Il controargomento degno di nota

Un commentatore che ha effettivamente distribuito un agente in un ospedale (solo 4 voti positivi, ma leggilo comunque):

“Recentemente ho distribuito un agente vocale AI in un ospedale che triage lo stato dei pazienti in modo misurabilmente più accurato rispetto al personale. Ci è voluto un sacco di messa a punto e un ottimo sistema di prompt che lo ha educato su come fare il triage dei pazienti, ma funziona benissimo.”

Nessun accenno a quale framework. Perché non importa. Ha trascorso il suo tempo sul prompt e sulla messa a punto, non sulla scelta tra LangChain e CrewAI.

La cosa che nessuno vuole dire ad alta voce

Il commento principale (75 voti positivi) su un popolare post “Ho passato 8 mesi a costruire agenti AI”?

“Grazie. Questo era davvero un buon ChatGPT.”

Secondo commento (49 voti positivi): “I post scritti da Chat GPT sono ovunque, ma ecco cosa ho imparato. nulla, perché non ho messo alcuno sforzo.”

Metà dei “report di esperienza” sui framework per agenti AI sono essi stessi generati da AI. Siamo in una sala degli specchi. Tieni questo a mente quando leggi articoli di confronto. Compreso, potenzialmente, questo — anche se mi piace pensare che i timestamp dell’API di GitHub e i link di Reddit mi diano un po’ di credibilità.

La Parte Economica

| LangSmith | Piattaforma CrewAI | AutoGen | |

|---|---|---|---|

| Gratuito | 5K tracce/mese, 1 posto | 50 esecuzioni/mese | Nessuna piattaforma esiste |

| Pagato | $39/posto/mese | $25/mese (100 esecuzioni) | — |

| Enterprise | Personalizzato | Personalizzato | — |

| Cosa stai pagando | Osservabilità e debugging | Hosting e orchestrazione | Il tuo tempo |

Questi numeri sono quasi irrilevanti. Ecco perché.

Una configurazione multi-agente in cui tre agenti discutono di un problema consuma 30-50K token per esecuzione. Al prezzo di GPT-4o ($2.50/1M input, $10/1M output), ciò si traduce in $0.15-0.75 per esecuzione. Eseguilo 1.000 volte al mese: $150-750 in costi API. La tariffa di $25/mese per la piattaforma CrewAI è un errore di arrotondamento a confronto.

Nel frattempo, il bot email da $200/mese di quel tipo su Reddit? Probabilmente $5-10/mese in chiamate API. Agente singolo, prompt singolo, chiamata a uno strumento singolo. I numeri sono brutali per le architetture multi-agente.

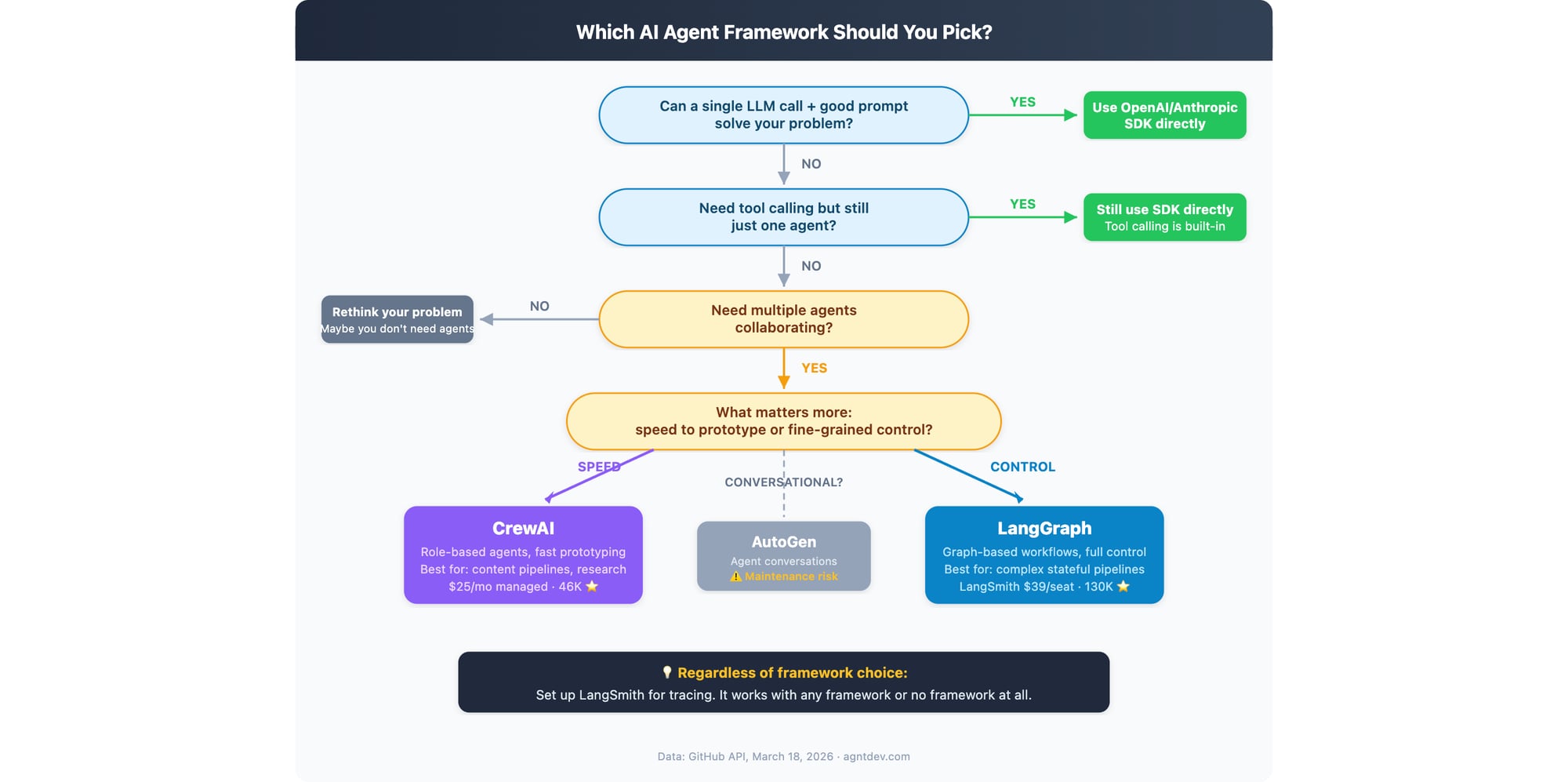

Il Diagramma di Flusso

In parole, perché non tutti caricano immagini:

Può una chiamata LLM con un buon prompt risolverlo? → Usa l’SDK. Fermati qui. La maggior parte dei problemi si trova qui e le persone non vogliono ammetterlo.

Serve chiamare strumenti ma ancora un agente solo? → Ancora l’SDK. La chiamata agli strumenti è nativa in ogni API LLM principale ora. Non hai bisogno di un framework per chiamare una funzione.

Hai veramente bisogno di più agenti? (Sii onesto con te stesso.)

→ Vuoi velocità per prototipare: CrewAI

→ Vuoi controllo totale sull’esecuzione: LangGraph

→ Vuoi agenti che conversano: AutoGen (ma leggi prima di nuovo la sezione sui rischi di manutenzione)

Hai bisogno di osservabilità in produzione? → LangSmith. Funziona con tutto, incluso nessun framework.

Cosa Farei Davvero

Non ciò che raccomanderei in una conferenza. Cosa farei veramente se dovessi consegnare qualcosa la prossima settimana:

- Costruisci v1 con chiamate SDK grezze. Brutto, manuale, senza astrazioni. Fallo funzionare. Guarda come fallisce. Comprendi perché fallisce.

- Se un agente sinceramente non riesce a gestirlo, prototipa la versione multi-agente in CrewAI. Ci vorrà un pomeriggio.

- Se il prototipo CrewAI funziona ma ho bisogno di un controllo più stretto per la produzione, riscrivi i percorsi critici in LangGraph. Mantieni CrewAI per le parti dove “buono abbastanza” è sufficiente.

- LangSmith fin dal primo giorno. Non negoziabile. Andare alla cieca con gli agenti in produzione è come ricevere chiamate alle 3 del mattino.

Il passo 5 è quello che nessuno segue: non aggiungere complessità fino a quando la versione semplice non fallisce in produzione. Non nei test. Non nella tua testa. In produzione, con utenti reali, che fanno cose reali. La maggior parte delle persone non supera mai il passo 1 perché il passo 1 funziona davvero.

Il framework è il 10% del risultato. Il prompt, le definizioni degli strumenti, la gestione degli errori, la valutazione — quello è il restante 90%. È lì che il ragazzo dell’ospedale ha trascorso il suo tempo. È lì che il ragazzo del bot email da $200/mese ha trascorso il suo tempo.

È lì che dovresti spendere il tuo.

Dati: GitHub API (18 marzo 2026), prezzi LangSmith, prezzi CrewAI. Thread su Reddit su r/AI_Agents e r/LangChain. Aggiornato il 19 marzo 2026.

Articoli Correlati

- Dominare il Testing degli Agenti: Un Tutorial Pratico con Esempi

- Migliori Strumenti di Completamento del Codice AI 2025: Aumentare la Produttività degli Sviluppatori

- Make vs Activepieces: Quale per Piccoli Team

🕒 Published: