Eu extraí a API do GitHub em 18 de março de 2026. Li os threads do Reddit com um total de 1.500+ votos positivos. Verifiquei as páginas de preços, as histórias de lançamento, os gráficos de commits.

Não são vibrações. São dados.

Números

| LangChain | CrewAI | AutoGen | |

|---|---|---|---|

| Estrelas no GitHub | 130.068 | 46.455 | 55.836 |

| Forks | 21.444 | 6.268 | 8.414 |

| Problemas Abertos | 505 | 494 | 684 |

| Licença | MIT | MIT | CC-BY-4.0 |

| Última Versão Estável | 17 mar 2026 | 18 mar 2026 (v1.11.0) | 30 set 2025 (v0.7.5) |

| Commits (últimas 4 semanas) | 187 no total | 3 RC em 3 dias | Quase zero |

| Nascido | Out 2022 | Out 2023 | Ago 2023 |

Fonte: API do GitHub, extraído em 18 de março de 2026.

LangChain: 130K estrelas, 47 commits/semana, três anos e meio de idade e ainda em aceleração. Diga o que quiser sobre o DX — a equipe entrega.

CrewAI: 46K estrelas em dois anos e meio. Três candidatos a release em três dias consecutivos antes que a v1.11.0 se tornasse estável. Energia de uma equipe pequena. Eles se movem rapidamente, provavelmente quebrando algumas coisas, mas pelo menos estão se movendo.

AutoGen: aqui as coisas ficam desconfortáveis. Última versão estável? Setembro de 2025. Seis meses de silêncio de um projeto apoiado pela Microsoft. 684 problemas abertos se acumulando. A reescrita da v0.4 dividiu a comunidade entre quem usa a antiga API e quem tenta entender a nova. Nenhum grupo parece estar satisfeito.

Mostre-me o Código

Chega de conversas. Aqui está a mesma tarefa — um agente de controle do clima — em cada framework mais o SDK vanilla. Avalie você mesmo.

Raw OpenAI SDK (sem framework)

from openai import OpenAI

import json

client = OpenAI()

def get_weather(city: str) -> str:

return f"72°F e ensolarado em {city}" # sua verdadeira chamada API aqui

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Obtenha o clima atual para uma cidade",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

}]

messages = [{"role": "user", "content": "Que tempo faz em Tóquio?"}]

response = client.chat.completions.create(

model="gpt-4o", messages=messages, tools=tools

)

# Gerencie a chamada da ferramenta

tool_call = response.choices[0].message.tool_calls[0]

result = get_weather(json.loads(tool_call.function.arguments)["city"])

messages.append(response.choices[0].message)

messages.append({"role": "tool", "content": result, "tool_call_id": tool_call.id})

final = client.chat.completions.create(model="gpt-4o", messages=messages)

print(final.choices[0].message.content)

25 linhas. Zero mágica. Veja cada mensagem que entra e sai. Quando quebra — e vai quebrar — você saberá exatamente onde olhar.

Isso era do que falava aquele post do Reddit com 685 votos positivos quando dizia “construa seu primeiro de forma bruta.”

LangChain

from langchain.agents import create_agent

def get_weather(city: str) -> str:

"""Obtenha o clima atual para uma cidade."""

return f"72°F e ensolarado em {city}"

agent = create_agent(

model="gpt-4o",

tools=[get_weather],

system_prompt="Você é um assistente de clima útil."

)

response = agent.invoke("Que tempo faz em Tóquio?")

print(response)

Limpo. Breve. E completamente opaco. O que acontece dentro de agent.invoke()? Ciclo de chamadas para ferramentas, formatação de mensagens, lógica de repetição, talvez algum template para o prompt. Tudo gerido para você. Maravilhoso — até às 2 da manhã quando seu agente começa a devolver nonsense e você está no meio de cinco camadas de abstração tentando entender qual comeu sua resposta da ferramenta.

O verdadeiro valor do LangChain não é a abstração do agente. São as mais de 150 integrações (cada armazenamento de vetores, cada fornecedor de LLM, cada carregador de documentos que você puder imaginar) e o LangSmith, que é realmente a melhor ferramenta de depuração para agentes disponível no momento. Mais sobre isso mais adiante.

CrewAI

from crewai import Agent, Task, Crew

from crewai.tools import tool

@tool

def get_weather(city: str) -> str:

"""Obtenha o clima atual para uma cidade."""

return f"22°C e ensolarado em {city}"

weather_agent = Agent(

role="Repórter do Clima",

goal="Fornecer informações meteorológicas precisas",

backstory="Você é um meteorologista que fornece relatórios meteorológicos concisos.",

tools=[get_weather]

)

task = Task(

description="Qual é o tempo em Tóquio?",

expected_output="Um breve relatório do clima",

agent=weather_agent

)

crew = Crew(agents=[weather_agent], tasks=[task])

result = crew.kickoff()

print(result)

Mais linhas, atmosfera completamente diferente. Você não está escrevendo um roteiro, você está fazendo um filme. role, goal, backstory — o agente tem um enredo de personagem antes mesmo de fazer algo.

Para verificar o clima? Ridículo sobrecarregar. Para um pipeline de conteúdo onde um “Pesquisador” cava fontes, um “Analista” encontra padrões e um “Escritor” escreve o texto? Agora a metáfora faz sentido. CrewAI brilha quando o problema realmente se assemelha ao trabalho em equipe.

AutoGen

import os

from autogen import AssistantAgent, UserProxyAgent

llm_config = {

"model": "gpt-4",

"api_key": os.environ["OPENAI_API_KEY"]

}

assistant = AssistantAgent("assistant", llm_config=llm_config)

user_proxy = UserProxyAgent("user_proxy", code_execution_config=False)

user_proxy.initiate_chat(assistant, message="Qual é o tempo em Tóquio?")

Dois agentes. Que falam um com o outro. Esse é todo o conceito de AutoGen — o modelo conversacional. UserProxyAgent finge ser você, AssistantAgent responde. Para brainstorm ou revisão de código, é um paradigma interessante.

Para “me avise apenas o clima em Tóquio”? É como contratar duas pessoas para uma reunião sobre como verificar o app do clima.

Além disso: o modelo no exemplo oficial deles ainda é gpt-4, não gpt-4o. A documentação não foi atualizada. É uma pequena coisa. Mas também não é uma pequena coisa.

O que realmente pensa o Reddit

Citações diretas. As contagens de votos positivos incluídas para que você possa avaliar por si mesmo.

A voz mais forte na sala diz: pule os frameworks

De um desenvolvedor que criou agentes para mais de 20 empresas (685 votos positivos):

“Não comece com LangChain ou CrewAI ou qualquer outra coisa que esteja na moda esta semana. Eles escondem demais. Você precisa entender o que acontece por trás dos bastidores. Escreva um script Python bruto que acesse a API da OpenAI ou da Anthropic. Envie uma mensagem. Obtenha uma resposta. Isso é tudo.”

De alguém que constrói agentes para clientes há dois anos (378 votos positivos):

“Aqueles que realmente ganham dinheiro e não quebram toda semana? Eles são embaraçosamente simples. Um único agente que lê e-mails e atualiza os campos do CRM (R$200/mês, funciona 24/7). Um parser de currículos que extrai informações-chave para recrutadores (R$50/mês). Nenhum desses requeriu uma orquestração de agentes. Ninguém precisou de sistemas de memória. Eles absolutamente não precisam de grupos de agentes se reunindo para decidir o que fazer.”

Seu stack de produção: API da OpenAI, n8n, um webhook, talvez Supabase. Isso é tudo. Ele está ganhando. O cara com o sistema CrewAI de 47 agentes está postando no LinkedIn.

O contra-argumento digno de nota

Um comentarista que realmente distribuiu um agente em um hospital (apenas 4 votos positivos, mas leia):

“Recentemente, implantei um agente de voz AI em um hospital que triage o estado dos pacientes de maneira mensuravelmente mais precisa do que a equipe. Demorou muito ajuste e um ótimo sistema de prompt que o educou sobre como fazer a triagem dos pacientes, mas está funcionando maravilhosamente.”

Sem menção a qual framework. Porque não importa. Ele gastou seu tempo no prompt e no ajuste, não na escolha entre LangChain e CrewAI.

A coisa que ninguém quer dizer em voz alta

O comentário principal (75 votos positivos) em um post popular “Passei 8 meses construindo agentes AI”?

“Obrigado. Isso era realmente um bom ChatGPT.”

Segundo comentário (49 votos positivos): “Os posts escritos pelo Chat GPT estão por toda parte, mas aqui está o que aprendi. nada, porque não fiz nenhum esforço.”

A metade dos “relatórios de experiência” sobre frameworks para agentes de IA são eles mesmos gerados por IA. Estamos em uma sala de espelhos. Tenha isso em mente ao ler artigos de comparação. Incluindo, potencialmente, este — mesmo que eu goste de pensar que os timestamps da API do GitHub e os links do Reddit me deem um pouco de credibilidade.

A Parte Econômica

| LangSmith | Plataforma CrewAI | AutoGen | |

|---|---|---|---|

| Gratuito | 5K pistas/mês, 1 lugar | 50 execuções/mês | Nenhuma plataforma existe |

| Pago | $39/lugar/mês | $25/mês (100 execuções) | — |

| Enterprise | Personalizado | Personalizado | — |

| O que você está pagando | Observabilidade e depuração | Hospedagem e orquestração | Seu tempo |

Esses números são quase irrelevantes. É por isso.

Uma configuração multi-agente onde três agentes discutem um problema consome 30-50K tokens por execução. Ao preço de GPT-4o ($2.50/1M de input, $10/1M de output), isso se traduz em $0.15-0.75 por execução. Execute isso 1.000 vezes por mês: $150-750 em custos de API. A taxa de $25/mês pela plataforma CrewAI é um erro de arredondamento em comparação.

Enquanto isso, o bot de e-mail de $200/mês daquele tipo no Reddit? Provavelmente $5-10/mês em chamadas de API. Agente único, prompt único, chamada para uma única ferramenta. Os números são brutais para arquiteturas multi-agente.

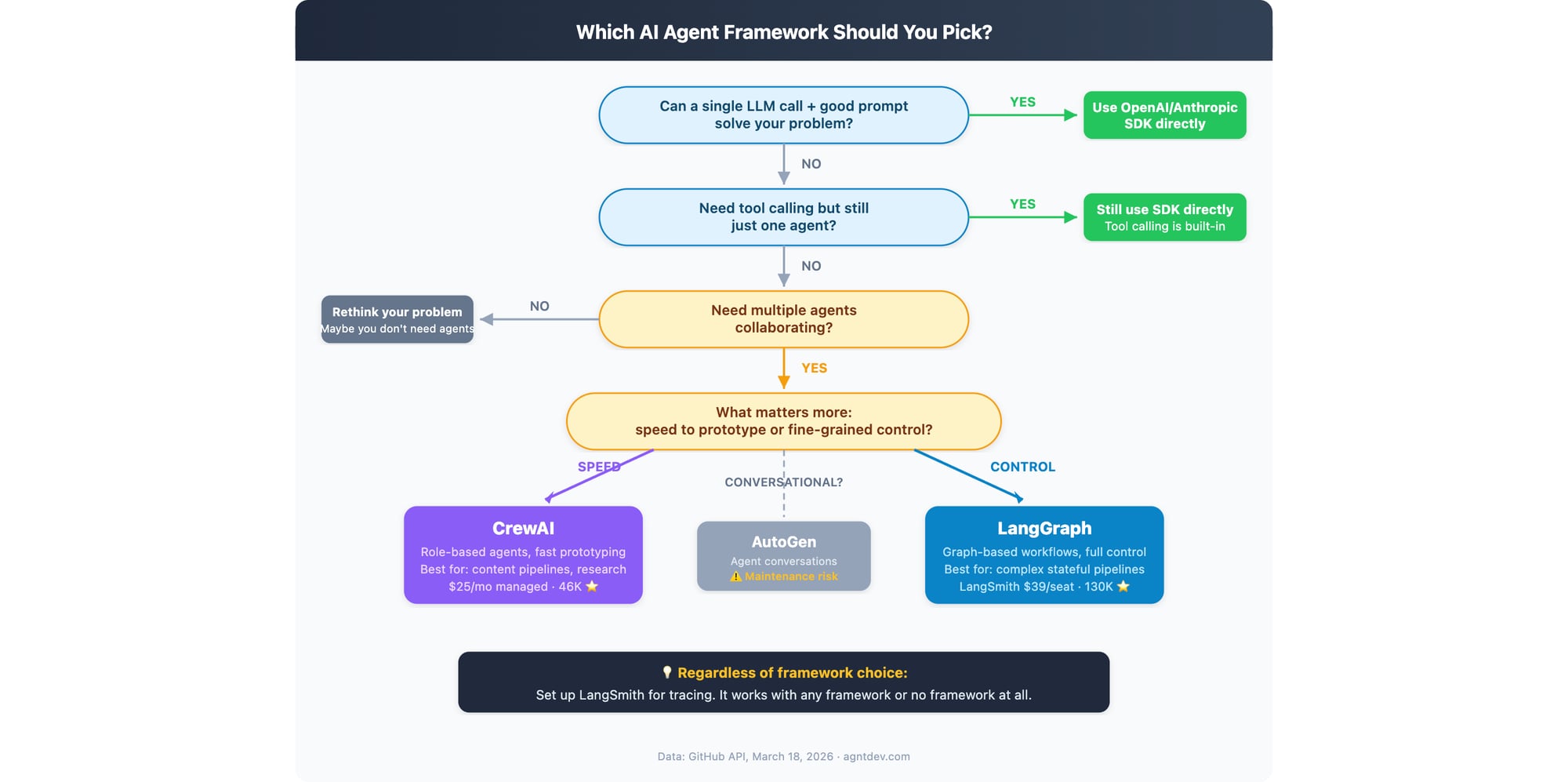

O Diagrama de Fluxo

Em palavras, porque nem todos carregam imagens:

Uma chamada LLM com um bom prompt pode resolver? → Use o SDK. Pare aqui. A maioria dos problemas está aqui, e as pessoas não querem admitir.

Preciso chamar ferramentas, mas ainda um agente só? → Ainda o SDK. A chamada para as ferramentas é nativa em todas as principais APIs de LLM agora. Você não precisa de um framework para chamar uma função.

Você realmente precisa de mais agentes? (Seja honesto consigo mesmo.)

→ Você quer velocidade para prototipar: CrewAI

→ Você quer controle total sobre a execução: LangGraph

→ Você quer agentes que conversam: AutoGen (mas leia antes novamente a seção sobre os riscos de manutenção)

Você precisa de observabilidade em produção? → LangSmith. Funciona com tudo, inclusive nenhum framework.

O que eu realmente faria

Não o que eu recomendaria em uma conferência. O que eu realmente faria se tivesse que entregar algo na próxima semana:

- Construa v1 com chamadas SDK brutas. Feio, manual, sem abstrações. Faça funcionar. Veja como falha. Entenda por que falha.

- Se um agente sinceramente não consegue lidar, prototipe a versão multi-agente no CrewAI. Isso levará uma tarde.

- Se o protótipo CrewAI funciona, mas eu preciso de um controle mais rigoroso para produção, reescreva os caminhos críticos no LangGraph. Mantenha CrewAI para as partes onde “suficientemente bom” é suficiente.

- LangSmith desde o primeiro dia. Não negociável. Ir às cegas com agentes em produção é como receber chamadas às 3 da manhã.

O passo 5 é o que ninguém segue: não adicione complexidade até que a versão simples falhe em produção. Não nos testes. Não na sua cabeça. Em produção, com usuários reais, que fazem coisas reais. A maioria das pessoas nunca supera o passo 1 porque o passo 1 realmente funciona.

O framework representa 10% do resultado. O prompt, as definições das ferramentas, a gestão de erros, a avaliação — isso é os 90% restantes. É lá que o cara do hospital passou seu tempo. É lá que o cara do bot de e-mail de $200/mês passou seu tempo.

É lá que você deve gastar o seu.

Dados: GitHub API (18 de março de 2026), preços LangSmith, preços CrewAI. Thread no Reddit em r/AI_Agents e r/LangChain. Atualizado em 19 de março de 2026.

Artigos Relacionados

- Dominando o Teste de Agentes: Um Tutorial Prático com Exemplos

- Melhores Ferramentas de Completação de Código AI 2025: Aumentando a Produtividade dos Desenvolvedores

- Make vs Activepieces: Qual Escolher para Pequenas Equipes

🕒 Published: